在当今的大模型后训练(Post-training)阶段,DPO(直接偏好优化) 凭借其无需训练独立 Reward Model 的优雅设计和高效性,成功取代 PPO 成为业界的 「版本之子」,被广泛应用于 Llama-3、Mistral 等顶流开源模型的对齐中。

然而,随着对模型能力要求的日益严苛,DPO 的缺陷逐渐浮出水面。

究竟该如何让 DPO 学会「去伪存真」,精准识别出那些真正决定胜负的 Critical Tokens?

针对这一问题,来自中国科学院自动化研究所、字节跳动、微软亚洲研究院和北京科技大学的研究者们在被选为 ICLR 2026 Oral 的新工作中联合提出了一种全新的 TI-DPO 框架。

- 论文:《Token-Importance Guided Direct Preference Optimization》

- 论文地址:https://arxiv.org/abs/2505.19653

- 开源地址:https://github.com/gracefulning/TIDPO

研究背景与意义

主流方法正面临两个核心难题,这使得模型难以实现真正精细化的语义控制:

- 痛点一:序列级的「二元对立」陷阱。传统方法依然停留在序列级别(Sequence-level)的粗粒度优化上,简单粗暴地将数据划分为好与坏。这种二元监督信号极度匮乏,因为它掩盖高质量回复中可能混杂着瑕疵 Token 的事实,导致了模型在连续语义空间中微调效果差,甚至引发采样分布偏移(Distribution Shift)。

- 痛点二:被偏差绑架的「伪」重要性。即使试图下沉到 Token 级别,现有的重要性评估手段也存在问题。许多方法依赖概率预测或简单加权,这导致它们直接继承了模型架构的固有缺陷 ——「U 型注意力偏差」(Lost in the Middle),模型天生倾向于过度关注首尾 Token 而忽略中间的核心语义。

TI-DPO 的核心机制

TI-DPO 的核心思想是:既然 Token 生而不同,那就给它们「加权」。 通过引入混合加权机制和三元组损失,TI-DPO 能够精准识别并放大「关键 Token」的信号,同时抑制噪声,从而实现比传统 DPO 更准、更稳的对齐效果。它主要包含两大核心机制:

1. 混合加权机制 (Hybrid Weighting)

为了找出谁才是决定回复质量的「胜负手」,TI-DPO 设计了一套数据驱动与先验结构相结合的权重计算法:

- 梯度归因:计算 Loss 对每个 Token Embedding 的梯度范数。简单来说,谁对最终输出贡献大,谁的权重就高。

- 高斯先验:针对 LLM 常见的「U 型注意力偏差」(过度关注开头结尾),引入高斯分布强制模型关注中间的语义核心。

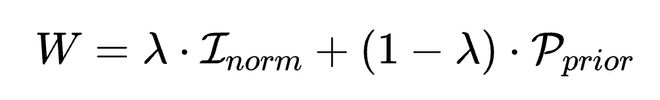

最终的 Token 权重 ,是这两者的凸组合: